AMD (NASDAQ: AMD) presentó su visión completa para una plataforma de IA totalmente integrada y anunció una innovadora infraestructura abierta y escalable para inteligencia artificial, diseñada sobre estándares de la industria, durante su evento Advancing AI 2025. AMD presenta su visión para un ecosistema abierto de IA, detallando nuevos procesadores, software y sistemas en el evento Advancing AI 2025.

“AMD está impulsando la innovación en IA a un ritmo sin precedentes, como lo demuestra el lanzamiento de nuestros aceleradores AMD Instinct Serie MI350, los avances en nuestras soluciones de próxima generación ‘Helios’ a escala de rack y el creciente impulso de nuestra pila de software abierto ROCm”, dijo la Dra. Lisa Su, presidenta y CEO de AMD. “Estamos entrando en la próxima fase de la IA, impulsada por estándares abiertos, innovación compartida y el liderazgo cada vez mayor de AMD en un amplio ecosistema de socios de hardware y software que están colaborando para definir el futuro de la IA”.

Evento Advancing AI 2025

- Solo AMD impulsa todo el espectro de la IA, reuniendo GPUs, CPUs, redes y software abierto líderes para ofrecer flexibilidad y rendimiento incomparables.

- Meta, OpenAI, xAI, Oracle, Microsoft, Cohere, HUMAIN, Red Hat, Astera Labs y Marvell discutieron cómo están colaborando con AMD para soluciones de IA.

AMD y sus socios destacaron:

- Cómo están construyendo el ecosistema abierto de IA con los nuevos aceleradores AMD Instinct™ Serie MI350.

- El continuo crecimiento del ecosistema AMD ROCm™.

- Los potentes diseños abiertos de AMD a escala de rack y su roadmap que promete un rendimiento líder en IA más allá de 2027.

AMD ofrece soluciones líderes para acelerar un ecosistema abierto de IA

AMD anunció un amplio portafolio de hardware, software y soluciones para impulsar todo el espectro de la IA:

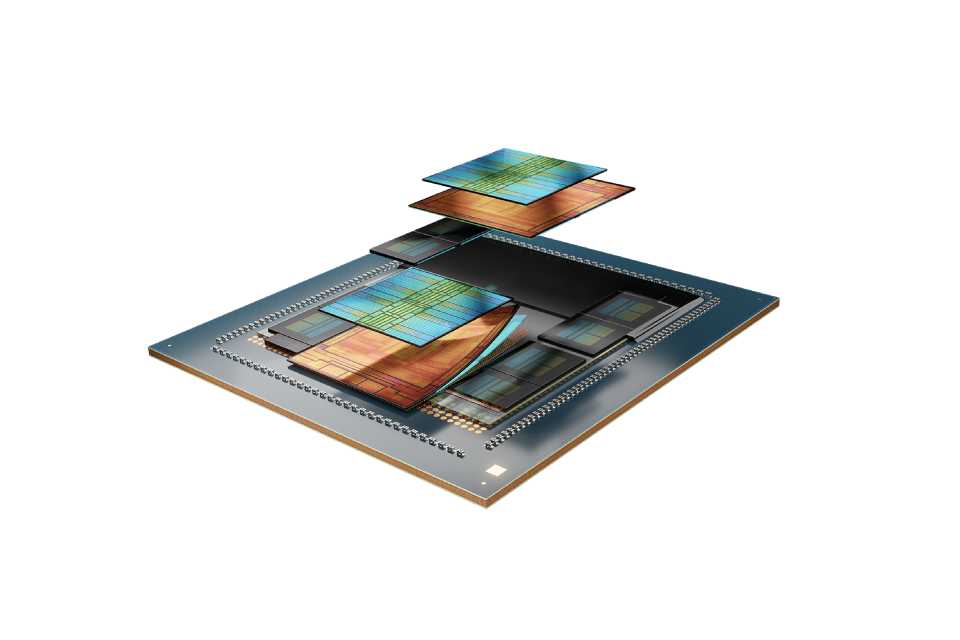

- AMD presentó los GPUs Instinct Serie MI350, estableciendo un nuevo estándar en rendimiento, eficiencia y escalabilidad para la IA generativa y la computación de alto rendimiento. La Serie MI350, que incluye los modelos Instinct MI350X y MI355X, ofrece un aumento[1] de 4x en capacidad de cómputo de IA en comparación con la generación anterior y un salto generacional de 35x en inferencia [2], abriendo camino a soluciones transformadoras de IA en diversas industrias. Además, el MI355X proporciona importantes mejoras en relación costo-rendimiento, generando hasta un 40% más de tokens por dólar en comparación con soluciones competidoras.[3] Más detalles están disponibles en este blog de Vamsi Boppana, vicepresidente sénior de IA en AMD. AMD presenta su visión para un ecosistema abierto de IA.

- AMD demostró su infraestructura de IA a escala de rack de extremo a extremo, ya implementada con los aceleradores AMD Instinct Serie MI350, procesadores AMD EPYC™ de 5ª generación y las NICs AMD Pensando™ Pollara en despliegues de hiperescala como Oracle Cloud Infrastructure (OCI). Esta solución estará disponible en la segunda mitad de 2025. AMD presenta su visión para un ecosistema abierto de IA.

- AMD también presentó un adelanto de su próxima generación de racks de IA, denominada «Helios». Este estará construido con los GPUs de próxima generación AMD Instinct Serie MI400, que se espera ofrezcan hasta 10x más rendimiento en la ejecución de inferencias en modelos Mixture of Experts [4] en comparación con la generación anterior. Además, incluirá los procesadores AMD EPYC «Venice» basados en la arquitectura «Zen 6» y las NICs AMD Pensando «Vulcano». Más detalles están disponibles en esta publicación del blog.

- La última versión de la pila de software de IA de código abierto de AMD, ROCm 7, ha sido diseñada para satisfacer las crecientes demandas de la IA generativa y las cargas de trabajo de computación de alto rendimiento, al mismo tiempo que mejora significativamente la experiencia de los desarrolladores en todos los aspectos. ROCm 7 incluye soporte mejorado para marcos estándar de la industria, compatibilidad ampliada con hardware y nuevas herramientas de desarrollo, controladores, APIs y bibliotecas destinadas a acelerar el desarrollo y la implementación de IA. Más detalles están disponibles en esta publicación de blog de Anush Elangovan, vicepresidente corporativo de Desarrollo de Software de IA en AMD. AMD presenta su visión para un ecosistema abierto de IA.

- Instinct Serie MI350 superó el objetivo de AMD a cinco años de mejorar la eficiencia energética en el entrenamiento de IA y los nodos de computación de alto rendimiento en 30x, logrando finalmente una mejora de 38x[5]. Además, AMD presentó un nuevo objetivo para 2030: aumentar 20x la eficiencia energética a escala de rack tomando como referencia el año base 2024[6]. Esto permitirá que un modelo típico de IA, que hoy requiere más de 275 racks para ser entrenado, pueda hacerlo en menos de un solo rack completamente utilizado para 2030, utilizando un 95% menos de electricidad.[7] Más detalles están disponibles en esta publicación de blog de Sam Naffziger, vicepresidente sénior y miembro corporativo de AMD.

- AMD también anunció la amplia disponibilidad de AMD Developer Cloud para las comunidades globales de desarrolladores y de código abierto. Diseñada específicamente para el desarrollo rápido y de alto rendimiento en IA, esta plataforma ofrecerá a los usuarios acceso a un entorno en la nube completamente gestionado, con herramientas y flexibilidad para iniciar proyectos de IA y escalarlos sin límites. Con ROCm 7 y AMD Developer Cloud, AMD está eliminando barreras y ampliando el acceso a la computación de próxima generación. Colaboraciones estratégicas con líderes como Hugging Face, OpenAI y Grok están demostrando el poder de soluciones abiertas y co-desarrolladas.

Ecosistema de socios líderes destaca los avances en IA impulsados por AMD

Actualmente, siete de las 10 principales empresas de desarrollo de modelos y compañías de IA están ejecutando cargas de trabajo de producción en aceleradores Instinct. Entre estas empresas se encuentran Meta, OpenAI, Microsoft y xAI, quienes se unieron a AMD y otros socios en el evento Advancing AI para discutir cómo están colaborando con AMD en soluciones de IA para entrenar los modelos de IA más avanzados de la actualidad, potenciar la inferencia a gran escala y acelerar la exploración y el desarrollo de IA:

- Meta detalló cómo el Instinct MI300X está ampliamente implementado para la inferencia de Llama 3 y Llama 4. Meta expresó su entusiasmo por el MI350, destacando su capacidad de cómputo, rendimiento por TCO (costo total de propiedad) y memoria de próxima generación. Meta continúa colaborando estrechamente con AMD en roadmaps de IA, incluyendo planes para la plataforma Instinct Serie MI400.

- El CEO de OpenAI, Sam Altman, habló sobre la importancia de optimizar de manera integral el hardware, el software y los algoritmos, así como de la estrecha colaboración de OpenAI con AMD en infraestructura de IA, con investigaciones y modelos GPT en producción sobre Azure utilizando MI300X, además de una colaboración profunda en el diseño de las plataformas de la Serie MI400.

- Oracle Cloud Infrastructure (OCI) se encuentra entre los primeros líderes de la industria en adoptar la infraestructura abierta de IA a escala de rack de AMD con GPUs AMD Instinct MI355X. OCI aprovecha los CPUs y GPUs de AMD para ofrecer un rendimiento equilibrado y escalable en clústeres de IA, y anunció que ofrecerá clústeres de IA a escala zetta acelerados por los últimos procesadores AMD Instinct, con hasta 131,072 GPUs MI355X, permitiendo a los clientes construir, entrenar e inferir IA a gran escala.

- HUMAIN habló sobre su acuerdo histórico con AMD para construir una infraestructura de IA abierta, escalable, resiliente y rentable, aprovechando todo el espectro de plataformas de cómputo que solo AMD puede proporcionar.

- Microsoft anunció que el Instinct MI300X ahora está impulsando modelos tanto propietarios como de código abierto en producción en Azure.

- Cohere compartió que sus modelos Command, de alto rendimiento y escalables, están implementados en el Instinct MI300X, proporcionando inferencia de LLM de nivel empresarial con alto rendimiento, eficiencia y privacidad de datos.

- Red Hat describió cómo su colaboración ampliada con AMD permite entornos de IA listos para producción, con GPUs AMD Instinct en Red Hat OpenShift AI, ofreciendo procesamiento de IA potente y eficiente en entornos híbridos de nube.

- Astera Labs destacó cómo el ecosistema abierto UALink acelera la innovación y ofrece mayor valor a los clientes, además de compartir planes para ofrecer un portafolio integral de productos UALink para respaldar la infraestructura de IA de próxima generación.

- Marvell se unió a AMD para resaltar su colaboración como parte del Consorcio UALink, desarrollando una interconexión abierta que brinda la máxima flexibilidad para la infraestructura de IA.

Acerca de AMD

Durante más de 55 años, AMD ha liderado la innovación en tecnologías de computación de alto rendimiento, gráficos y visualización. Cientos de millones de consumidores, empresas Fortune 500 e instalaciones científicas líderes en todo el mundo confían en la tecnología de AMD para mejorar cómo viven, trabajan y se divierten. Los empleados de AMD están enfocados en desarrollar productos líderes en rendimiento y adaptabilidad que amplían los límites de lo posible. Para obtener más información sobre cómo AMD está transformando el presente e inspirando el futuro, visita www.amd.com.

Cautionary Statement

This press release contains forward-looking statements concerning Advanced Micro Devices, Inc. (AMD) such as the features, functionality, performance, availability, timing and expected benefits of AMD products and roadmaps; AMD’s AI platform; and AMD’s partner ecosystem, which are made pursuant to the Safe Harbor provisions of the Private Securities Litigation Reform Act of 1995. Forward-looking statements are commonly identified by words such as «would,» «may,» «expects,» «believes,» «plans,» «intends,» «projects» and other terms with similar meaning. Investors are cautioned that the forward-looking statements in this press release are based on current beliefs, assumptions and expectations, speak only as of the date of this press release and involve risks and uncertainties that could cause actual results to differ materially from current expectations. Such statements are subject to certain known and unknown risks and uncertainties, many of which are difficult to predict and generally beyond AMD’s control, that could cause actual results and other future events to differ materially from those expressed in, or implied or projected by, the forward-looking information and statements. Material factors that could cause actual results to differ materially from current expectations include, without limitation, the following: Intel Corporation’s dominance of the microprocessor market and its aggressive business practices; Nvidia’s dominance in the graphics processing unit market and its aggressive business practices; competitive markets in which AMD’s products are sold; the cyclical nature of the semiconductor industry; market conditions of the industries in which AMD products are sold; AMD’s ability to introduce products on a timely basis with expected features and performance levels; loss of a significant customer; economic and market uncertainty; quarterly and seasonal sales patterns; AMD’s ability to adequately protect its technology or other intellectual property; unfavorable currency exchange rate fluctuations; ability of third party manufacturers to manufacture AMD’s products on a timely basis in sufficient quantities and using competitive technologies; availability of essential equipment, materials, substrates or manufacturing processes; ability to achieve expected manufacturing yields for AMD’s products; AMD’s ability to generate revenue from its semi-custom SoC products; potential security vulnerabilities; potential security incidents including IT outages, data loss, data breaches and cyberattacks; uncertainties involving the ordering and shipment of AMD’s products; AMD’s reliance on third-party intellectual property to design and introduce new products; AMD’s reliance on third-party companies for design, manufacture and supply of motherboards, software, memory and other computer platform components; AMD’s reliance on Microsoft and other software vendors’ support to design and develop software to run on AMD’s products; AMD’s reliance on third-party distributors and add-in-board partners; impact of modification or interruption of AMD’s internal business processes and information systems; compatibility of AMD’s products with some or all industrystandard software and hardware; costs related to defective products; efficiency of AMD’s supply chain; AMD’s ability to rely on third party supply-chain logistics functions; AMD’s ability to effectively control sales of its products on the gray market; long-term impact of climate change on AMD’s business; impact of government actions and regulations such as export regulations, tariffs and trade protection measures, and licensing requirements; AMD’s ability to realize its deferred tax assets; potential tax liabilities; current and future claims and litigation; impact of environmental laws, conflict minerals related provisions and other laws or regulations; evolving expectations from governments, investors, customers and other stakeholders regarding corporate responsibility matters; issues related to the responsible use of AI; restrictions imposed by agreements governing AMD’s notes, the guarantees of Xilinx’s notes, the revolving credit agreement and the ZT Systems credit agreement; impact of acquisitions, joint ventures and/or strategic investments on AMD’s business and AMD’s ability to integrate acquired businesses, including ZT Systems; AMD’s ability to sell the ZT Systems manufacturing business; impact of any impairment of the combined company’s assets; political, legal and economic risks and natural disasters; future impairments of technology license purchases; AMD’s ability to attract and retain qualified personnel; and AMD’s stock price volatility. Investors are urged to review in detail the risks and uncertainties in AMD’s Securities and Exchange Commission filings, including but not limited to AMD’s most recent reports on Forms 10-K and 10-Q. AMD, the AMD Arrow logo, EPYC, AMD CDNA, AMD Instinct, Pensando, ROCm, Ryzen, and combinations thereof are trademarks of Advanced Micro Devices, Inc. Other names are for informational purposes only and may be trademarks of their respective owners.

[1] Based on calculations by AMD Performance Labs in May 2025, to determine the peak theoretical precision performance of eight (8) AMD Instinct™ MI355X and MI350X GPUs (Platform) and eight (8) AMD Instinct MI325X, MI300X, MI250X and MI100 GPUs (Platform) using the FP16, FP8, FP6 and FP4 datatypes with Matrix. Server manufacturers may vary configurations, yielding different results. Results may vary based on use of the latest drivers and optimizations.

MI350-004

[2] MI350-044:Based on AMD internal testing as of 6/9/2025. Using 8 GPU AMD Instinct™ MI355X Platform measuring text generated online serving inference throughput for Llama 3.1-405B chat model (FP4) compared 8 GPU AMD Instinct™ MI300X Platform performance with (FP8). Test was performed using input length of 32768 tokens and an output length of 1024 tokens with concurrency set to best available throughput to achieve 60ms on each platform, 1 for MI300X (35.3ms) and 64ms for MI355X platforms (50.6ms). Server manufacturers may vary configurations, yielding different results. Performance may vary based on use of latest drivers and optimizations.

[3] Based on performance testing by AMD Labs as of 6/6/2025, measuring the text generated inference throughput on the LLaMA 3.1-405B model using the FP4 datatype with various combinations of input, output token length with AMD Instinct™ MI355X 8x GPU, and published results for the NVIDIA B200 HGX 8xGPU. Performance per dollar calculated with current pricing for NVIDIA B200 available from Coreweave website and expected Instinct MI355X based cloud instance pricing. Server manufacturers may vary configurations, yielding different results. Performance may vary based on use of latest drivers and optimizations. Current customer pricing as of June 10, 2025, and subject to change. MI350-049

[4] MI400-001: Performance projection as of 06/05/2025 using engineering estimates based on the design of a future AMD Instinct MI400 Series GPU compared to the Instinct MI355x, with 2K and 16K prefill with TP8, EP8 and projected inference performance, and using a GenAI training model evaluated with GEMM and Attention algorithms for the Instinct MI400 Series. Results may vary when products are released in market. (MI400-001)

[5] EPYC-030a: Calculation includes 1) base case kWhr use projections in 2025 conducted with Koomey Analytics based on available research and data that includes segment specific projected 2025 deployment volumes and data center power utilization effectiveness (PUE) including GPU HPC and machine learning (ML) installations and 2) AMD

- [6] AMD based advanced racks for AI training/inference in each year (2024 to 2030) based on AMD roadmaps, also examining historical trends to inform rack design choices and technology improvements to align projected goals and historical trends. The 2024 rack is based on the MI300X node, which is comparable to the Nvidia H100 and reflects current common practice in AI deployments in 2024/2025 timeframe. The 2030 rack is based on an AMD system and silicon design expectations for that time frame. In each case, AMD specified components like GPUs, CPUs, DRAM, storage, cooling, and communications, tracking component and defined rack characteristics for power and performance. Calculations do not include power used for cooling air or water supply outside the racks but do include power for fans and pumps internal to the racks.

Performance improvements are estimated based on progress in compute output (delivered, sustained, not peak FLOPS), memory (HBM) bandwidth, and network (scale-up) bandwidth, expressed as indices and weighted by the following factors for training and inference.

| FLOPS | HBM BW | Scale-up BW | |

| Training | 70.0% | 10.0% | 20.0% |

| Inference | 45.0% | 32.5% | 22.5% |

Performance and power use per rack together imply trends in performance per watt over time for training and inference, then indices for progress in training and inference are weighted 50:50 to get the final estimate of AMD projected progress by 2030 (20x). The performance number assumes continued AI model progress in exploiting lower precision math formats for both training and inference which results in both an increase in effective FLOPS and a reduction in required bandwidth per FLOP.

- [7] AMD estimated the number of racks to train a typical notable AI model based on EPOCH AI data (https://epoch.ai).

For this calculation we assume, based on these data, that a typical model takes 1025 floating point operations to train

(based on the median of 2025 data), and that this training takes place over 1 month. FLOPs needed = 10^25 FLOPs/(seconds/month)/Model FLOPs utilization (MFU) = 10^25/(2.6298*10^6)/0.6. Racks = FLOPs needed/(FLOPS/rack in 2024 and 2030). The compute performance estimates from the AMD roadmap suggests that approximately 276 racks would be needed in 2025 to train a typical model over one month using the MI300X product (assuming 22.656 PFLOPS/rack with 60% MFU) and <1 fully utilized rack would be needed to train the same model in 2030 using a rack configuration based on an AMD roadmap projection. These calculations imply a >276-fold reduction in the number of racks to train the same model over this six-year period. Electricity use for a MI300X system to completely train a defined 2025 AI model using a 2024 rack is calculated at ~7GWh, whereas the future 2030 AMD system could train the same model using ~350 MWh, a 95% reduction. AMD then applied carbon intensities per kWh from the International Energy Agency World Energy Outlook 2024

[https://www.iea.org/reports/world-energy-outlook-2024]. IEA’s stated policy case gives carbon intensities for 2023 and 2030. We determined the average annual change in intensity from 2023 to 2030 and applied that to the 2023 intensity to get 2024 intensity (434 CO2 g/kWh) versus the 2030 intensity (312 CO2 g/kWh). Emissions for the 2024 baseline scenario of 7 GWh x 434 CO2 g/kWh equates to approximately 3000 metric tC02, versus the future 2030 scenario of 350 MWh x 312 CO2 g/kWh equates to around100 metric tCO2.